当我们在使用 AI 工具的时候,经常会看到设置选项中出现 LoRA 这个单词。它是做什么的?又有什么用呢?

LoRA 是什么?

在 AI 工具中,LoRA 指的是”低秩近似方法(Low Rank Approximation)”。在机器学习和数据处理中,低秩近似是一种降低数据维度的技术,可以帮助简化复杂的数据结构,减少存储空间和计算成本。

这种方法被广泛应用于图像处理、自然语言处理、推荐系统等领域,用来处理大规模数据并提高算法的效率和性能。

看不懂?没事,打个比方你就知道了

当我们谈论 LoRA 时,可以将其比喻为做汉堡包的过程。想象一下,你有一大堆食材,包括面包、汉堡肉、生菜、番茄等等。

现在你要做一个美味的汉堡包,但是你并不需要用所有的食材,而是选择其中最重要的几样,比如面包、汉堡肉和生菜,来构建一个简单但美味的汉堡。

这样,你既节省了食材,又可以在短时间内完成制作,而且味道依然很棒。如果你希望汉堡包更加具有风味,那么就可以在原有的基础汉堡包(LoRA 模型)上,加上自己的独特的酱料(自己的 Prompt 提示词),并创建出一个独特的汉堡(结果)!

所以,在 AI 中,LoRA 就是从复杂的数据中挑选出最重要的特征,来构建一个简化但有效、并且可以重复使用的模型。LoRA 简化、概括、保留重要的信息,忽略不太重要的细节,从而让 AI 更有效地处理和分析数据。

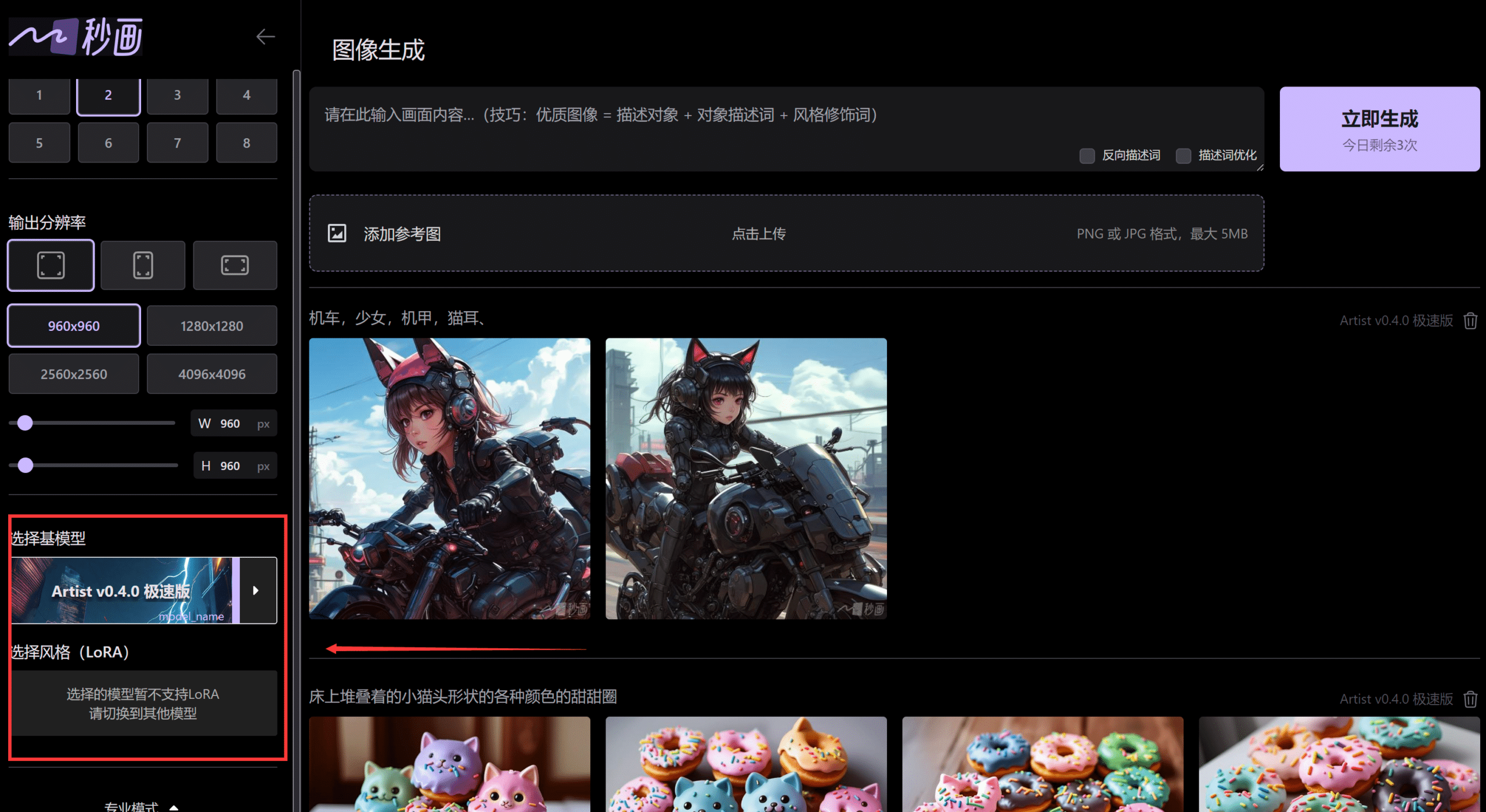

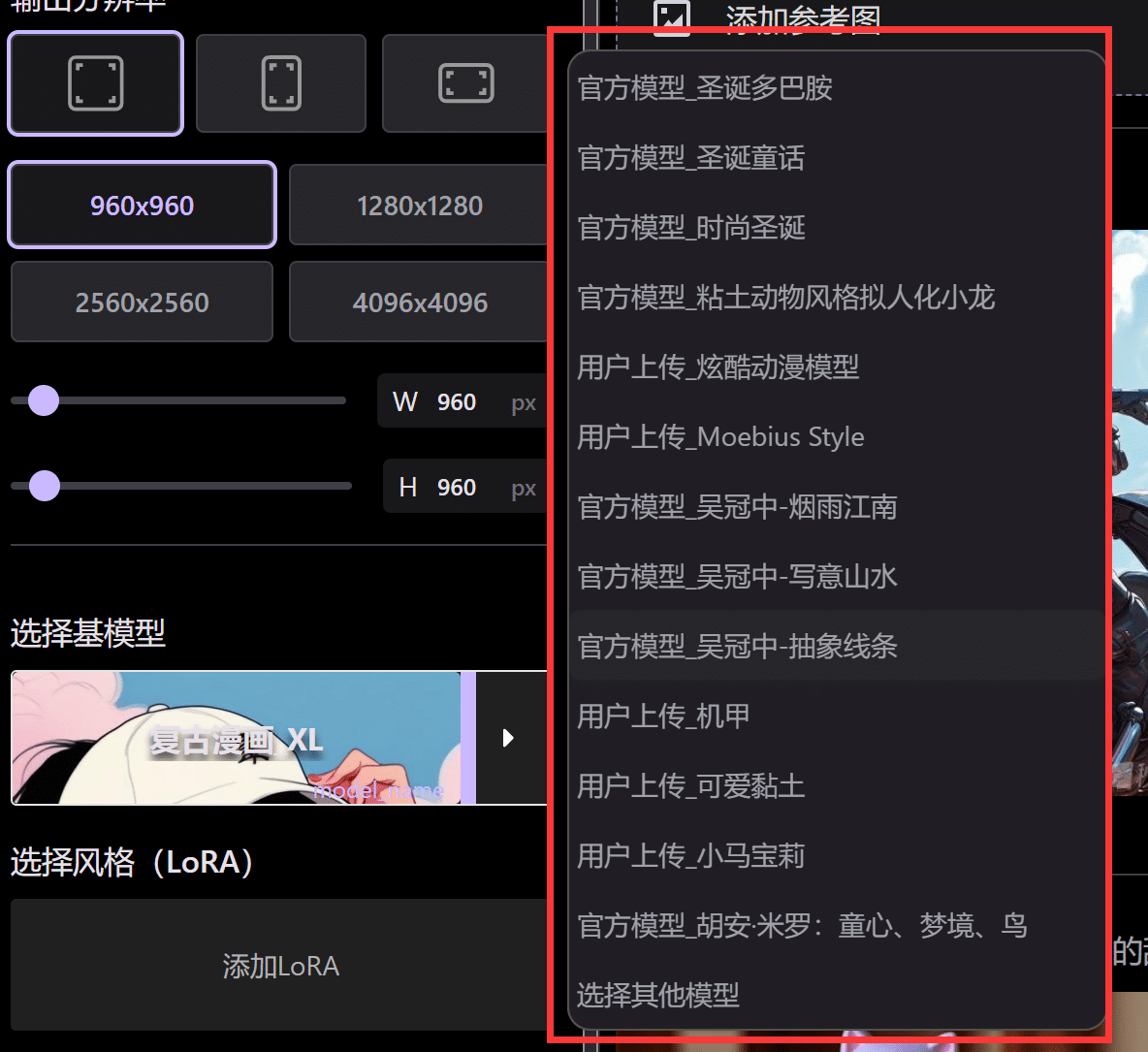

例如在我们整理的 AI 图片生成工具中有一个叫做秒画的工具。在它生成图片时,你可以选择生成图片的基础模型,以及 LoRA 模型(这里你可以理解为风格)。

当你选择一个主模型之后,就可以选择其支持的 LoRA 模型。因为大部分的 LoRA 模型是用户制作好,并上传给其他用户使用的。

这就好比你先让别人帮你先用简单的的线条勾勒出一个形象,而不是绘制出每一个细节。然后再让机器根据你的提示词(Prompt)在此基础上再进行创作。这样得到的结果会更加贴近你的需求。

LoRA 的优缺点

刚才在定义中说了 LoRA可以简化、概括、保留重要的信息,忽略不太重要的细节,让 AI 处理更加有效率。那么就意味着,它的优势是:

优势

- 可以让 AI 有更多的内存去处理其他数据,降低计算成本。

- 处理速度更快,提高模型的处理速度。

- 可以过滤掉没有用的信息(去除噪声和冗余信息)

- 节省存储空间,尤其是在处理大量数据的时候。

那么同时,也会有其劣势:

劣势

- 可能会导致一定程度上的信息损失,因为它忽略了数据中的一些细节信息,可能会影响结果的精确度。

- 对于某些数据结构复杂的情况,LoRA 可能不太适用,因为它可能无法很好地概括数据的特征。

总结

LoRA 是一种低秩近似方法,通过提取数据的关键特征、忽略部分细节信息,从而加快模型的训练和预测速度,使得模型更加简洁高效。

然而,使用 LoRA 也需要注意选择适当的模型(规则),以避免信息损失过多导致生成内容不符合预期。